ChatGPTのような生成AIを法務実務で活用する場合のリスクと懸念

スポンサーリンク

ChatGPTのような生成AIを法務実務で活用する場合のリスクと懸念について書きます。

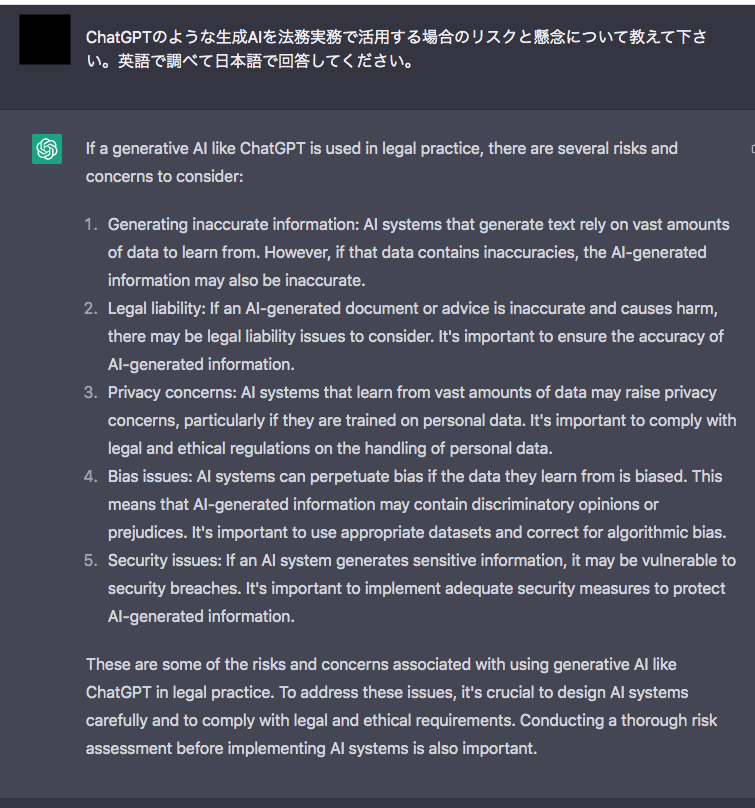

今回はChatGPTにて、「ChatGPTのような生成AIを法務実務で活用する場合のリスクと懸念について教えて下さい。英語で調べて日本語で回答してください。」という質問をしてみた。

質問し得られた回答が上記になる。「英語で調べて日本語で回答してください。」と質問しているのに、なぜか英語の文章だったので、DeepL翻訳で翻訳し情報を共有します。

ChatGPTのような生成型AIを法律実務で使用する場合、いくつかのリスクと懸念があります。

1.不正確な情報を生成する。 テキストを生成するAIシステムは、学習するために膨大な量のデータに依存しています。しかし、そのデータに不正確なものが含まれている場合、AIが生成する情報も不正確なものになる可能性があります。

2.法的責任。AIが生成した文書やアドバイスが不正確で損害を与えた場合、法的責任の問題を考慮する必要があるかもしれません。AIが生成する情報の正確性を確保することは重要です。

3.プライバシーに関する懸念。膨大な量のデータから学習するAIシステムは、特に個人データを対象に学習させる場合、プライバシーに関する懸念をもたらす可能性があります。個人データの取り扱いに関する法的・倫理的な規制を遵守することが重要です。

4.バイアスの問題。AIシステムは、学習するデータが偏っている場合、バイアスを永続させる可能性があります。つまり、AIが生成した情報には、差別的な意見や偏見が含まれている可能性があります。適切なデータセットを使用し、アルゴリズムによるバイアスを補正することが重要です。

5.セキュリティの問題。AIシステムが機密情報を生成する場合、セキュリティ侵害の危険性があります。AIが生成した情報を保護するために、適切なセキュリティ対策を実施することが重要です。

以上、ChatGPTのような生成型AIを法律実務に活用する際のリスクや懸念事項を挙げてきました。これらの問題に対処するためには、AIシステムを慎重に設計し、法的・倫理的要件を遵守することが肝要です。また、AIシステムを導入する前に、徹底したリスク評価を行うことも重要です。

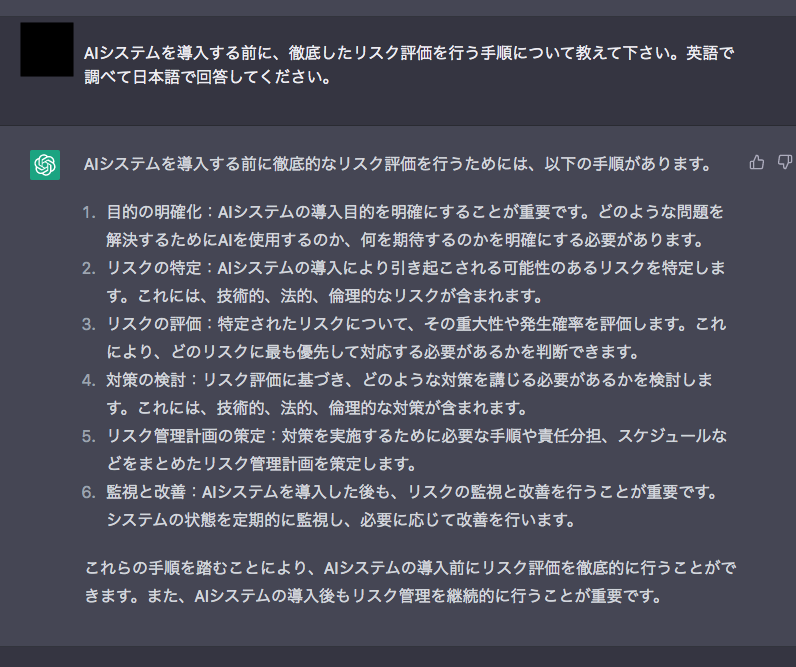

翻訳した結果がこちらです。この結果から、ChatGPTに「AIシステムを導入する前に、徹底したリスク評価を行う手順について教えて下さい。英語で調べて日本語で回答してください。」と質問してみた。

AIシステムを導入する前に徹底的なリスク評価を行うためには、以下の手順があります。

- 目的の明確化:AIシステムの導入目的を明確にすることが重要です。どのような問題を解決するためにAIを使用するのか、何を期待するのかを明確にする必要があります。

- リスクの特定:AIシステムの導入により引き起こされる可能性のあるリスクを特定します。これには、技術的、法的、倫理的なリスクが含まれます。

- リスクの評価:特定されたリスクについて、その重大性や発生確率を評価します。これにより、どのリスクに最も優先して対応する必要があるかを判断できます。

- 対策の検討:リスク評価に基づき、どのような対策を講じる必要があるかを検討します。これには、技術的、法的、倫理的な対策が含まれます。

- リスク管理計画の策定:対策を実施するために必要な手順や責任分担、スケジュールなどをまとめたリスク管理計画を策定します。

- 監視と改善:AIシステムを導入した後も、リスクの監視と改善を行うことが重要です。システムの状態を定期的に監視し、必要に応じて改善を行います。

これらの手順を踏むことにより、AIシステムの導入前にリスク評価を徹底的に行うことができます。また、AIシステムの導入後もリスク管理を継続的に行うことが重要です。

質問後、得られた回答が上記となる。今回は日本語で生成された。この文章を読んでみたが問題なさそうだと判断し、情報として公開します。

これ以外にもネットの情報でこれは参考になるというものを掲載しておきます。ご参考になれば幸いです。

「The Implications of ChatGPT for Legal Services and Society(ChatGPTが法律サービスと社会に与える影響)」では「Challenges and ethical considerations(課題と倫理的配慮)」の項目で、「ChatGPTは大量のテキストデータでトレーニングされているため、特定の法律トピックに関する最新情報や関連情報が常に提供されるわけではない」ことが書かれており、やはり法的責任の問題を考慮する必要がある。また「法律のニュアンスや複雑さを必ずしも考慮できない可能性がある」とも書かれているので、これはまだ人間の弁護士などが行う仕事であると考える。