ChatGPTを自治体で用いる場合のリスクと懸念

スポンサーリンク

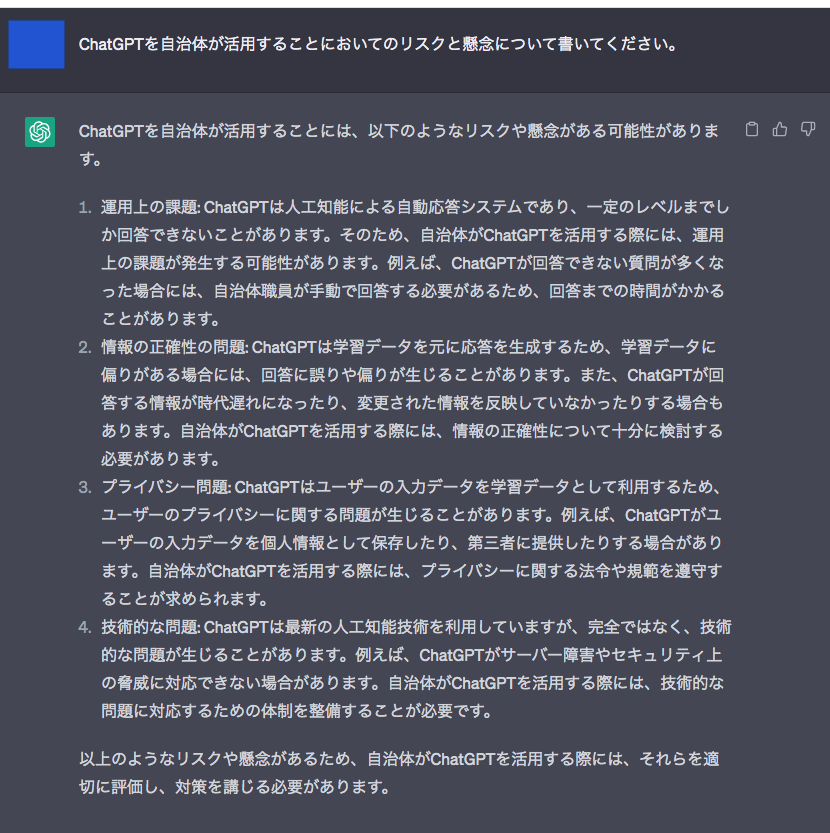

ChatGPTを行政機関で用いる場合のリスクと懸念について公開したが、今回は「ChatGPTを自治体が活用することにおいてのリスクと懸念」について気になったので、ChatGPTに直接「ChatGPTを自治体が活用することにおいてのリスクと懸念について書いてください。」と質問してみました。

ChatGPTを自治体が活用することには、以下のようなリスクや懸念がある可能性があります。

1.運用上の課題: ChatGPTは人工知能による自動応答システムであり、一定のレベルまでしか回答できないことがあります。そのため、自治体がChatGPTを活用する際には、運用上の課題が発生する可能性があります。例えば、ChatGPTが回答できない質問が多くなった場合には、自治体職員が手動で回答する必要があるため、回答までの時間がかかることがあります。

2.情報の正確性の問題: ChatGPTは学習データを元に応答を生成するため、学習データに偏りがある場合には、回答に誤りや偏りが生じることがあります。また、ChatGPTが回答する情報が時代遅れになったり、変更された情報を反映していなかったりする場合もあります。自治体がChatGPTを活用する際には、情報の正確性について十分に検討する必要があります。

3.プライバシー問題: ChatGPTはユーザーの入力データを学習データとして利用するため、ユーザーのプライバシーに関する問題が生じることがあります。例えば、ChatGPTがユーザーの入力データを個人情報として保存したり、第三者に提供したりする場合があります。自治体がChatGPTを活用する際には、プライバシーに関する法令や規範を遵守することが求められます。

4.技術的な問題: ChatGPTは最新の人工知能技術を利用していますが、完全ではなく、技術的な問題が生じることがあります。例えば、ChatGPTがサーバー障害やセキュリティ上の脅威に対応できない場合があります。自治体がChatGPTを活用する際には、技術的な問題に対応するための体制を整備することが必要です。

以上のようなリスクや懸念があるため、自治体がChatGPTを活用する際には、それらを適切に評価し、対策を講じる必要があります。

質問後、得られた回答が上記となる。この回答を読んでみたが特に問題はなさそうだと判断し、情報として共有する。あと、この回答で特に気をつけなければいけないことは「情報の正確性の問題」と「プライバシー問題」この2つではないかと考えているが、ChatGPTというテクノロジーを無視できなくなってきているので、横須賀市が自治体初となる導入を行ったように、今後導入を検討するところが増えてくると予想する。